作者|Mandy Gu

编译|Flin

来源|towardsdatascience

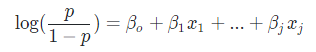

Logistic回归,通过估计事件发生的对数概率来对事件发生的概率进行建模。如果我们假设对数比值和 j 个自变量之间存在线性关系,那么我们可以将事件发生的概率p建模为:

你可能注意到未指定对数底。对数的底数其实并不重要,回想一下,如果我们把两边都乘以logk b,我们可以把底数b改成任何新的底数k。

这使我们可以灵活地假设左侧的底数。当然,底数会影响对结果和系数值的解释。

分离概率

如果我们有估计系数,就很容易分离出p。注意,p/(1-p)表示事件发生的概率。

我们将用另一个例子来解释说明。房地产经纪人吉姆(Jim)训练了一个逻辑回归模型来预测某人出价买房的可能性。他通过使用两个解释变量来保持他的模型的简洁性:

-

x1:潜在客户拜访房子的次数

-

这栋房子的要价是几千美元

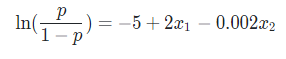

在使用程序确定最优系数后,Jim为他的模型推导出这些系数:

Jim的模型告诉我们:

-

潜在买家每多一次拜访,平均概率自然对数增加2

-

房屋每增加1000美元,平均概率的自然对数下降0.002

听起来很拗口,而且很难听懂。我们可以用一个更简单的技巧来解释。

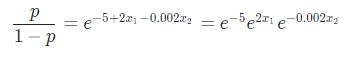

我们可以计算e的2次方和-0.002次方的值来简化解释。

-

潜在买家平均每增加一次造访的时间,他提出报价的概率就会增加约7.39倍

-

房屋每增加1000美元,平均出价的概率会受到0.998倍的影响

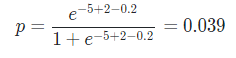

如果吉姆的客户,Sue,参观了一次房子,房子价值100万美元,那么我们可以用上面推导出的公式来估计她购买房子的概率。

这表明Sue有大约4%的概率出价买下这所房子。

作为一个分类器

尽管logistic回归是一种回归模型,但它经常被用于分类。概率总是在0和1之间。我们可以设置一个任意的阈值来预测观察到的类别。

我们还可以将logistic回归扩展为两个以上的分类器,使其成为一个多类分类器。为此,我们可以采取“ 一对一”的方法,即训练尽可能多的逻辑回归模型(每个模型预测一个类别的对数概率),并采用产生最高推断概率的类别。

欢迎关注磐创AI博客站:

http://panchuang.net/

sklearn机器学习中文官方文档:

http://sklearn123.com/

欢迎关注磐创博客资源汇总站:

http://docs.panchuang.net/

原创文章,作者:磐石,如若转载,请注明出处:https://panchuang.net/2020/09/01/%e6%95%b0%e6%8d%ae%e7%a7%91%e5%ad%a6%e9%80%9f%e6%88%90%e7%8f%ad%ef%bc%9a%e8%a7%a3%e9%87%8a%e9%80%bb%e8%be%91%e5%9b%9e%e5%bd%92/