计算机视觉正在成为一种日益有效的技术,用于处理常见的农业任务,如产量预测、植物种类识别、病害检测和杂草管理。其中,杂草管理是一项特别重要的任务,因为它对作物产量的影响最大。化学除草管理采用全覆盖喷洒或选择性喷洒除草剂。由于过度使用除草剂,全覆盖喷洒会降低作物产量,加剧健康和生态问题,而选择性喷洒则专门针对杂草,以增加作物产量和保护周围的生态系统。传统的选择性喷洒是一种劳动强度大、耗时长的自动杂草检测系统,因此能够准确、高效、低成本地实时识别杂草是农业机器视觉系统的首要目标。在这篇短文中,总结了[1]和[2]中的讨论。

解决方案通常应用传统的机器学习(ML)或深度学习(DL)。一般情况下,传统的最大似然方法需要较少的训练数据,计算量也较低。然而,深厚的领域专业知识对于手工制作信息最丰富的特征作为传统ML算法的输入至关重要。由于杂草和农作物占据的自然环境复杂,杂草识别问题极具挑战性。在常见的图像数据变化来源中,如遮挡、重叠对象、阴影效果、运动模糊和噪声,其中一些在杂草检测中尤其难以克服,对于这些杂草检测,即使是经过专业设计的特征也可能不是最优的。这些特征可分为颜色、纹理、形状和光谱模态。单独使用时,基于颜色的特征是最不可靠的,因为类间(植物物种之间)和类内(同一物种实例之间)的颜色差异可以忽略不计。树叶的颜色也高度依赖于季节、气候、地理、光照条件和疾病等因素。类似的因素影响叶片光谱特征的有效性,例如它们的反射率。形状和纹理特征对重叠或遮挡都很敏感。一些纹理特征,如灰度共生矩阵(GLCM),更稳健,但由于其较大的计算复杂度,对于实时推理同样不切实际。虽然可以组合这些模态中的每一个特征以提高检测精度,但是模型™的性能取决于特征选择的质量,并且很可能一些重要的植物特征将不被利用。

虽然传统的最大似然算法在实时精确杂草管理方面显示出很好的前景,尤其是支持向量机(SVM),但它们的性能大多优于DL方法。DL自动学习并选择关于特定学习任务渐近接近最优的最佳分层特征。与传统的ML不同,训练神经网络进行分类需要的数据量要大得多。包含各种杂草或作物物种的公共数据集很少,更不用说那些包含真实田野图像的数据集了。然而,即使是同一物种的数据集也可能具有有限的可转移性,因为季节性、地理和生长阶段引起的变化。DL通过自动功能选择获得了什么,但由于在标记数据方面的大量手动工作,它失去了什么。未来在主动学习、半监督学习、自我监督学习、少机会学习或零机会学习方面的研究将有助于将标签成本降至最低。

通常,数码相机或多光谱相机安装在数据采集车上,以捕获RGB通道、近红外(NIR)数据或其他光谱数据。预处理这些原始图像有助于网络™的学习能力,可以包括调整图像大小以调整分辨率或提高计算效率、去除背景以消除阴影效果和碎片、去除运动模糊、去噪、数据白化和通道归一化。随后,扩充训练数据以提高DL模型的泛化性能。增强技术包括几何变换、伽马校正、裁剪、核滤波、噪声注入和颜色空间变换。颜色增强对于实时推理特别有利,因为它使模型能够学习在农业机器人运动时如何响应不断变化的照明条件。

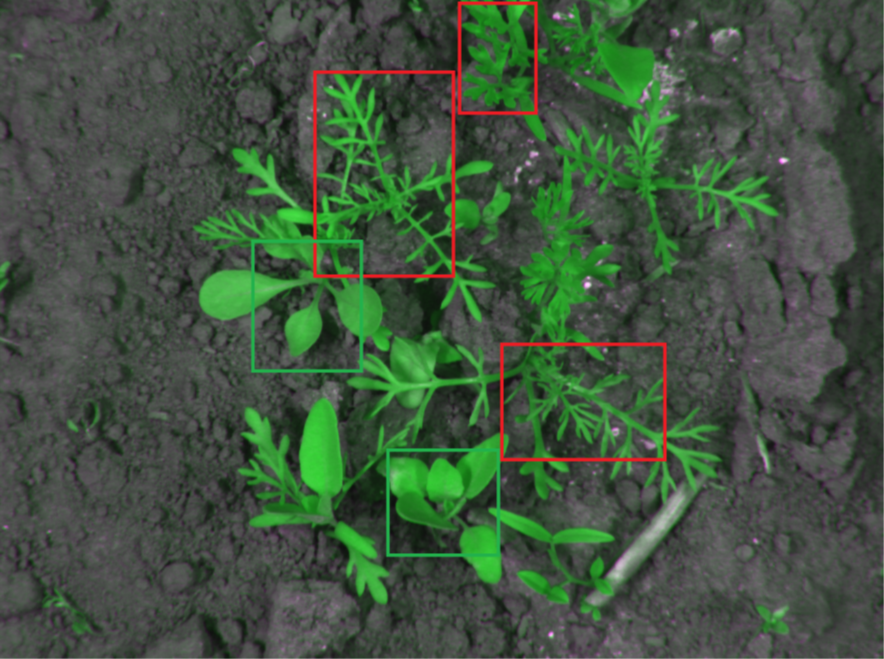

根据对杂草进行分类的方法不同,文献中DL结构的范围分为卷积神经网络(CNN)、全卷积网络(FCN)、区域建议网络(RPN)、图卷积网络(GCN)或混合网络(HN)中的一种。在CNN内部,研究人员使用转移学习从公共数据集(如ImageNet[3]、CoCo[4]和Kitti[5])获取预先训练好的权重,并对各种流行的图像分类架构进行了比较。其中一些是AlexNet、VGG-19、GoogLeNet、Nasnet、Inception-ResNet、DetectNet、ResNet-50、ResNet-101和Inception-v3。根据分类的物种、考虑的类的数量和分类运行时的不同,最佳模型会有所不同。HNS(如AgroAVNET)结合了AlexNet和VGGNet的结构特性,根据它们对整体模型性能的影响组合了多个模型的体系结构特征。下一级抽象将是使用RPN预测杂草的包围盒。这种目标检测方法已经成功地使用了YOLO-v3、FASTER R-CNN、单发探测器(SSD)和Mask R-CNN等模型。这些对象检测框架中的特征提取器可以是具有前述架构的精调版本的CNN或FCN。另外,微型YOLO-v3模型在精度上有较小的折衷,可以加快YOLO-v3的推理时间,更适合于实时推理。现代GPU针对卷积运算进行了优化,因此转向完全卷积网络可以加快训练时间。FCN可以在像素级进行分类,用于语义图像分割,通常的方法采用诸如SegNet或U-Net的众所周知的编解码器体系结构,例如以ResNet或VGG的变体作为编码块。FCN中的端到端反向传播意味着学习到的特征对于分类器来说将是最优的,因为特征学习器与分类器是耦合的。分割精度在很大程度上依赖于数据集的大小,因此可以应用迁移学习来抢占学习的先机,而数据增强技术可以人为地增加训练数据量。最后,GCNS(如Graph Weed Network(GWN))将图像表示为图,并被认为是半监督方法,因为未注释的节点可以通过具有已知标签的附近节点的加权平均来近似标注。有关基于DL的杂草检测的许多方法的更深入讨论,请参阅[1]中的第10节。

与微小的架构驱动的分类精度改进相比,模型选择的一个更重要的因素可能是算法复杂度较低,以满足实时图像处理的要求。这将使准确和及时地使用适合杂草种类的除草剂成为可能。处理速度还取决于硬件的效率,无论机器人是采集数据进行训练,还是对看不见的现场数据进行推理。人工智能基础设施公司有能力和专业知识利用先进的嵌入式GPU和网络基础设施来构建定制的移动单元。现代化的解决方案满足快速实时图像处理的标准,使企业能够充分利用数字农业中强大的DL。

参考文献:

[1]马慕杜尔·哈桑,A.S.M.;Sohel,F;Diepeveen,D;Laga,H;G.K.Jones,M.图像中杂草检测的深度学习技术研究.CoRR,ABS/2103.01415,2021年,https://arxiv.org/abs/2103.01415https://arxiv.org/abs/2103.01415

[2]吴振中;陈勇;赵兵;康霞;丁勇。基于计算机视觉的杂草检测方法综述。传感器2021,21,3647。https://doi.org/10.3390/s21113647https://doi.org/10.3390/s21113647

[3]邓军;董伟;索彻,R;李立;李凯;李芳,ImageNet:一个大规模的层次化图像数据库。见2009年IEEE计算机视觉与模式识别会议论文集,美国佛罗里达州迈阿密,20?EURO“2009年6月25日;第248?EURO”255页。

[4]Lin T.;Maire,M.;Belongie,S.;Hays,J.;Perona,P.;Ramanan,D.;Doll O.r,P.;Zitnick,L.Microsoft Coco:Context中的常见对象;Springer:苏黎世。瑞士,2014年;740?欧元“755页。

[5]Geiger,A.;Lenz,P.;Stiller,C.;Urtasun,R.(2013)。视觉与机器人相遇:Kitti数据集。“国际机器人研究杂志”,32(11),1231{1237}。

原创文章,作者:fendouai,如若转载,请注明出处:https://panchuang.net/2021/07/02/%e5%9f%ba%e4%ba%8e%e6%b7%b1%e5%ba%a6%e5%ad%a6%e4%b9%a0%e7%9a%84%e8%ae%a1%e7%ae%97%e6%9c%ba%e8%a7%86%e8%a7%89%e6%9d%82%e8%8d%89%e5%ae%9e%e6%97%b6%e6%a3%80%e6%b5%8b%e4%b8%8e%e5%88%86%e7%b1%bb/