里程碑:基于CNN的单级探测器

在深度学习时代,目标检测可以分为两种类型:欧元œ两阶段检测欧元�和欧元œ一阶段检测欧元�,前者将检测过程框定为从粗到精的欧元œ�过程,而后者将其框定为欧元œ一步完成的欧元�过程。在深度学习时代,目标检测可以分为两种类型:一种是欧元两阶段检测,另一种是欧元一阶段检测,前者将检测过程框定为从粗到精的过程,后者将其框定为一步完成的过程。

YOLO:你只看一次(2015)

原稿:您只需看一次:统一的实时对象检测You Only Look Once: Unified, Real-Time Object Detection

概述

我们将目标检测重新定义为一个单一的回归问题,直接从图像像素到边界框坐标和类别概率。使用我们的系统,您只需查看图像一次(YOLO),即可预测存在哪些对象以及它们位于何处。

YOLO对全图像进行训练,直接优化检测性能。与传统的目标检测方法相比,该统一模型具有几个优点。

- 首先,YOLO速度非常快。因为我们将帧检测作为一个回归问题来处理,所以我们不需要复杂的管道(™)。

- 第二,在进行预测时,YOLO对图像进行全局推理。与滑动窗口和基于区域建议的技术不同,YOLO在训练和测试期间看到整个图像,因此它隐含地编码关于类及其外观的上下文信息。

- 第三,YOLO学习对象的概括性表示。将其应用于新域或意外输入时,故障发生的可能性较小。

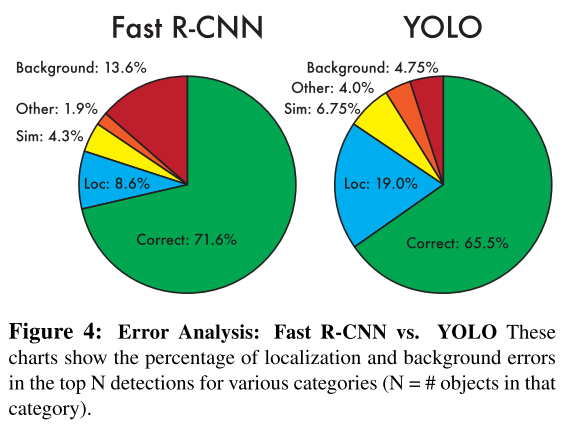

然而,YOLO在准确性方面仍落后于最先进的检测系统。虽然它可以快速识别图像中的物体,但它很难精确定位一些物体,特别是小物体。随后,作者在YOLO的基础上进行了一系列改进,提出了其v2和v3版本,在保持很高检测速度的同时,进一步提高了检测精度。

统一检测

我们将目标检测的独立组件统一到单个神经网络中。我们的网络使用整个图像中的特征来预测每个边界框。它还可以同时预测图像中所有类别的所有边界框。这意味着我们的网络对整个图像和图像中的所有对象进行全局推理。

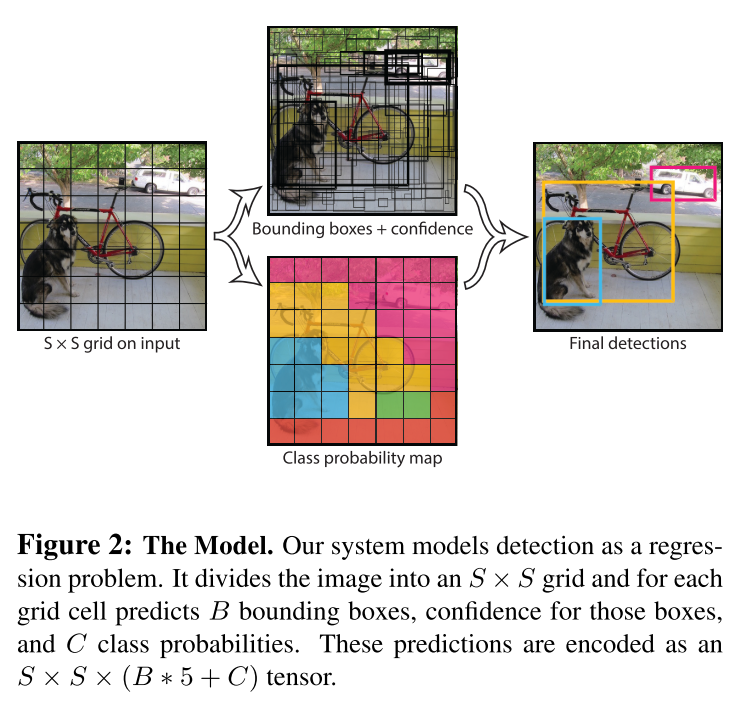

我们的系统将输入图像划分为Sç-S网格。如果对象的中心落入网格单元,则该网格单元负责检测该对象。每个网格单元预测B个边界框,每个边界框由5个预测组成:

- 4长方体坐标:(x,y)坐标表示长方体相对于网格单元边界的中心。宽度和高度是相对于整个图像进行预测的。

- 1置信分数:PR(对象)-ˆ-IOU(TRUE_PRED)。如果该单元格中不存在任何对象,则应为零。否则,它应该等于预测框和地面事实之间的并集交集(IOU)。它反映了模型对长方体包含对象的确信程度,以及它认为长方体预测的精确度有多高。

每个网格单元还预测C个条件类概率:PR(Class_I|Object)。这些概率以包含对象的网格单元为条件。我们只预测每个网格单元的一组分类概率,而不考虑框B的数量。

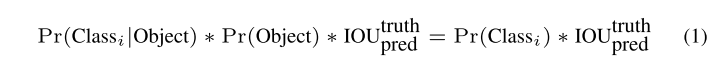

在测试时,我们将条件类概率和单个框的置信度预测相乘,以计算每个框的类特定置信度分数。这些分数既编码了该类出现在框中的概率,也编码了预测框与对象的匹配程度。

为了计算PASCAL VOC上的YOLO,我们使用S=7,B=2。PASCAL VOC有20个标记类,所以C=20。我们最终的预测是7°-7°-30张量。

网络设计

我们将该模型实现为卷积神经网络,并在PASCAL VOC检测数据集上进行了评估。网络的初始卷积层从图像中提取特征,而完全连通的层预测输出概率和坐标。我们网络的最终输出是预测的7-7-30张量。

培训

我们在ImageNet 1000级竞争数据集上预先训练我们的卷积层。对于预训练,我们使用图3中的前20个卷积层,然后是平均池化层和完全连接层。然后,我们通过添加四个卷积层和两个具有随机初始化权的全连通层来将模型转换为执行检测。检测通常需要细粒度的视觉信息,因此我们将网络的输入分辨率从224-224提高到448-448。

我们的最后一层预测类概率和边界框坐标。我们使用图像宽度和高度来归一化边界框的宽度和高度,使它们落在0和1之间。我们将边界框的x和y坐标参数化为特定网格单元位置的偏移量,以便它们也在0和1之间。

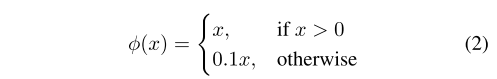

我们对最终层使用线性激活函数,所有其他层使用以下泄漏校正的线性激活:

我们对模型输出中的平方和误差进行优化,因为它很容易优化,但是它并不完全符合我们最大化平均精度的目标。它将定位误差与可能不理想的分类误差同等加权。此外,在每个图像中,许多网格单元都不包含任何对象。这会将这些单元格的“EUROUREœCONNECTURITY”�分数推向零,通常会压倒确实包含对象的单元格的梯度。这可能会导致模型不稳定,导致早期训练出现分歧。

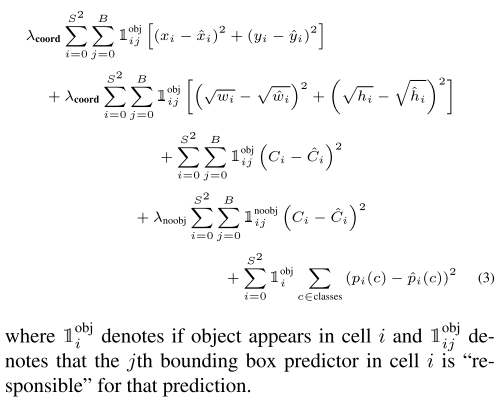

为了解决这个问题,我们增加了边界框坐标预测的损失,并减少了对不包含对象的框的置信度预测的损失。对于不包含对象的框,我们增加了边界框坐标预测的损失,减少了置信度预测的损失。我们使用两个参数:i»_coord和i»_noobj来完成此操作,并设置i»_coord=5和i»_noobj=0.5。

平方和误差在大盒子和小盒子中的权重也是相等的。我们的误差度量应该反映大框中的小偏差比小框中的小偏差重要,因此我们直接预测边界框的宽度和高度的平方根,而不是宽度和高度。

YOLO预测每个栅格单元格有多个边界框。在训练时,我们只需要一个边界框预测器来负责每个对象。我们指定一个预报器来负责预测一个对象,该对象的预测基于哪个预测具有与基本事实最高的当前借条(IOU)。œ�负责预测一个对象,该对象基于哪个预测具有最高的当前借条。这导致了边界框预测值之间的专门化。每个预测器都能更好地预测对象的特定大小、纵横比或类别,从而提高整体回忆能力。在培训期间,我们优化了以下多部分损失函数:

请注意,损失函数仅在该网格单元中存在对象时惩罚分类错误。它也仅在预测器是基础真值框的-uroœResponsible-uro�(即,在该网格单元格中具有任何预测器中最高的借条)的情况下才惩罚边界框坐标错误(即,在该网格单元格中具有任何预测器中最高的借条)。

推理

就像在训练中一样,对测试图像的预测检测只需要一次网络评估,因此YOLO在测试时非常快。

网格设计加强了边界框预测中的空间多样性。通常,对象落入哪个网格单元是很清楚的,并且网络只为每个对象预测一个框。但是,多个单元格的边界附近的一些大对象或对象可以被多个单元格很好地定位。可以使用非最大抑制来修复这些多个检测。

YOLO的局限性

- 它对边界框预测施加了很强的空间约束,因为每个网格单元只能预测两个框,并且只能有一个类。此空间约束限制了模型可以预测的附近对象的数量。

- 它与成群出现的小物体搏斗,比如成群的鸟。

- 它很难推广到新的或不寻常的长宽比或配置中的对象,因为它学会了从数据中预测边界框。

- 它还使用相对粗糙的特征来预测边界框,因为该体系结构具有来自输入图像的多个下采样层。

- Lost函数将小边界框中的错误与大边界框中的错误进行相同的处理。大盒子中的小错误通常是良性的,但小盒子中的小错误对IOU的影响要大得多。错误的主要来源是不正确的本地化。

SSD:单次拍摄多盒探测器(2015)

原稿:SSD:单次放炮多盒探测器SSD: Single Shot MultiBox Detector

概述

- SSD是一款适用于多个类别的单次拍摄检测器,比YOLO更快、更准确。

- 事实上,它与执行显式区域建议和合并的较慢技术一样准确(包括较快的R-CNN)。

- SSD的核心是使用应用于要素地图的小卷积过滤器来预测一组固定默认边界框的类别分数和框偏移量。

- 它从不同尺度的特征地图中产生不同尺度的预测,并通过长宽比显式分隔预测。

- 这些设计特征导致简单的端到端训练和高精度,即使在低分辨率输入图像上也是如此,进一步提高了速度与精度之间的权衡。

- (A)在训练过程中,SSD只需要为每个对象输入图像和地面真值框。

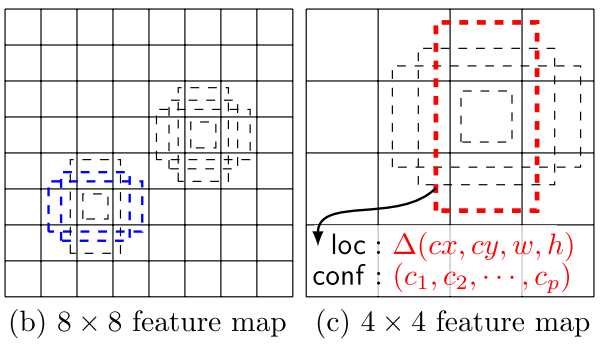

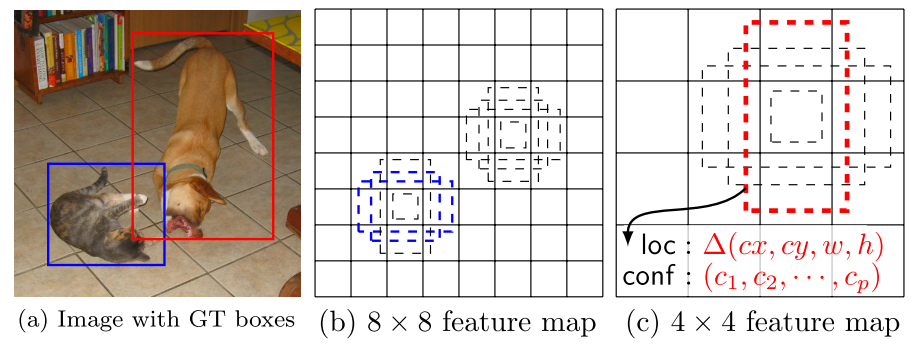

- 以卷积的方式,我们在几个不同比例的特征地图(例如,(B)和(C)中的8-8和4-4)中,评估在每个位置具有不同纵横比的默认框的小集合(例如,4个)。

- 对于每个缺省框,我们预测所有对象类别((c1,c2,···,cp)的形状偏移量和置信度。

- 在训练时,我们首先将这些默认框与基本事实框相匹配。例如,我们将两个默认框与猫匹配,一个与狗匹配,这两个默认框被视为正面,而睡觉被视为负面。

- 模型损失是定位损失(例如平滑L1)和置信度损失(例如Softmax)之间的加权和。

固态硬盘:型号

SSD方法基于前馈卷积网络,该前馈卷积网络产生固定大小的边界框集合和这些框中存在的对象类实例的分数,随后是非最大抑制步骤以产生最终检测。

早期的网络层基于用于高质量图像分类的标准体系结构(在任何分类层之前被截断),我们将其称为基本网络。然后,我们将辅助结构添加到网络中,以产生具有以下关键功能的检测:

用于检测的多尺度特征图我们在截断的基本网络的末端添加卷积特征层。这些层的大小逐渐减小,并允许在多个尺度上进行检测预测。用于预测检测的卷积模型对于每个要素图层是不同的(YOLO在单比例要素地图上操作)。

用于检测每个添加的特征层(或者可选地来自基础网络的现有特征层)的卷积预测器可以使用一组卷积滤波器来产生一组固定的检测预测。对于具有p个通道的大小为m?-n的特征层,用于预测潜在检测参数的基本元素是3?3?p小核,该小核产生类别的分数或相对于缺省框坐标的形状偏移量。

在应用内核的m-n个位置中的每个位置,它都会产生一个输出值。边界框偏移输出值是相对于相对于每个要素地图位置的默认框位置进行测量的(在此步骤中,YOLO使用中间完全连接的图层,而不是卷积过滤)。

默认框和纵横比对于网络顶部的多个要素地图,我们将一组默认边界框与每个要素地图单元相关联。默认框以卷积方式平铺特征地图,使得每个框相对于其相应单元的位置是固定的。在每个要素地图单元格中,我们预测相对于单元格中默认框形状的偏移量,以及指示每个框中存在类实例的每个类的分数。

具体地说,对于给定位置的k个长方体中的每个长方体,我们计算c类分数和相对于原始默认长方体形状的4个偏移量。这导致总共(c+4)k个滤波器应用于特征图中的每个位置,产生m-n特征图的(c+4)kMN输出。

我们的默认框类似于在更快的R-CNN中使用的锚框,但是,我们将它们应用于几个不同分辨率的要素地图。允许在几个特征映射中使用不同的默认框形状,使我们可以有效地离散化可能的输出框形状的空间。

SSD在基础网络的末端添加了几个要素层,这些要素层预测不同比例和纵横比的默认框的偏移量及其相关置信度。

固态硬盘:培训

匹配策略在训练过程中,我们需要确定哪些缺省框对应于地面真相检测。对于每个地面真值框,我们将从位置、纵横比和比例不同的默认框中进行选择。我们首先将每个基本事实框与具有最佳Jaccard重叠的默认框进行匹配。然后,我们将缺省框与Jaccard重叠大于阈值(0.5)的任何基本事实进行匹配。这简化了学习问题,允许网络预测多个重叠的默认框的高分,而不是要求它只选择重叠程度最大的一个。

选择默认框的比例和纵横比来处理不同的对象比例,我们利用单个网络中多个不同层的特征映射进行预测,同时还共享所有对象比例的参数。

图1显示了框架中使用的两个样本特性地图(8°-8和4°-4)。在实践中,我们可以用很小的计算开销使用更多。

我们设计了默认方框的平铺,以便特定的要素地图能够响应对象的特定比例。假设我们想要使用m个特征映射进行预测。每个要素地图的默认框的比例计算如下:

通过将来自许多要素地图的所有位置的具有不同比例和纵横比的所有默认框的预测组合在一起,我们获得了涵盖各种输入对象大小和形状的不同预测集。

例如,狗与4奥-4特征地图中的默认框匹配,但不与8奥-8特征地图中的任何默认框匹配。这是因为这些盒子有不同的刻度,与狗盒不匹配,因此在训练期间被认为是负片。

硬否定挖掘在匹配步骤之后,大多数默认框都是否定的,特别是当可能的默认框的数量很大时。这导致了正面和负面培训示例之间的严重不平衡。我们没有使用所有的反例,而是按照每个缺省框的最高置信度对它们进行排序,并挑选最上面的示例,使得反例和正例的比例最多为3:1。我们发现,这会导致更快的优化和更稳定的训练。

数据增强为了使模型对各种输入对象大小和形状更加稳健,通过以下选项之一随机采样每个训练图像:

- 使用整个原始输入图像。

- 对面片进行采样,以便与对象的最小Jaccard重叠为0.1、0.3、0.5、0.7或0.9。

- 随机抽样一个补丁。

每个采样块的大小为原始图像大小的[0.1,1],长宽比在1/2到2之间。如果地面真值盒的中心在采样块中,则保留地面真值盒的重叠部分。在上述采样步骤之后,除了应用一些光度学扭曲外,还会将每个采样面片的大小调整为固定大小,并以0.5的概率水平翻转。

模型分析

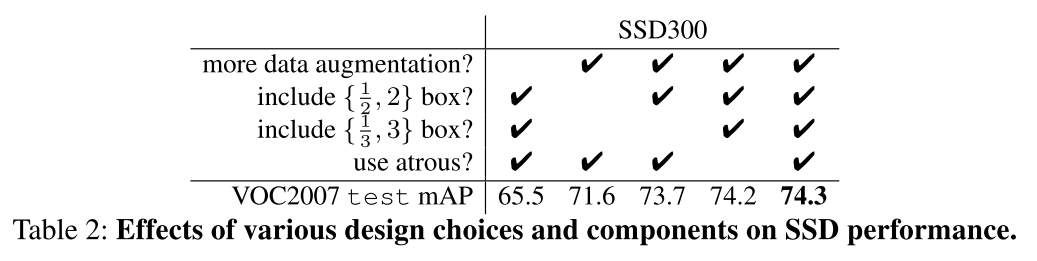

数据增强至关重要。快速、快速的R-CNN使用原始图像和水平翻转进行训练。我们使用更广泛的抽样策略,类似于YOLO。表2显示,使用此抽样策略,我们可以提高8.8%的MAP。

默认框形状越多越好。表2显示移除包装盒会严重影响性能。使用各种默认框形状似乎可以使网络更容易预测框的任务。

阿特鲁斯更快。我们使用的是次采样VGG16的ATHOS版本。如果我们使用完整的VGG16,结果是大致相同的,而速度大约慢了20%。

以不同分辨率的多个输出层为佳。SSD的一个主要贡献是在不同的输出层上使用不同比例的默认框。为了衡量获得的优势,我们逐步去掉各层并比较结果。为了进行公平的比较,每次删除图层时,我们都会调整默认的框平铺,以保持框的总数与原始框相似(8732)。这是通过在其余图层上堆叠更多比例的长方体,并根据需要调整长方体的比例来实现的。当我们在一个层上堆叠多个比例的长方体时,很多都在图像边界上,需要小心处理。我们尝试了在速度更快的R-CNN中使用的策略,忽略了边界上的方框。我们不会为每种设置详尽地优化平铺。表3显示了层较少时精度的下降,从74.3单调下降到62.4。

实现小目标精度的数据增强

如果没有更快的R-CNN中的后续特征重采样步骤,小对象的分类任务对于SSD来说是相对困难的。上一次会议中介绍的数据增强策略有助于显著提高性能,特别是在小型数据集上。

由该策略生成的随机作物可以被认为是一种œ放大�操作,并且可以生成许多更大的训练示例。为了实现一个创建更多小训练示例的“EUROœZOOM-�”操作,我们在执行任何随机裁剪操作之前,将一幅图像随机放置在原始图像大小为16°的画布上,该画布上填满了平均值。

因为我们通过引入这个新的“œ扩展”“�数据增强技巧”获得了更多的训练图像,所以我们必须将训练迭代次数增加一倍。我们已经看到多个数据集的MAP持续增加了2%-3%,新的增强技巧显著提高了小对象的性能。这一结果强调了数据增强策略对最终模型精度的重要性。

RetinaNet(2017年)

原文:密集目标检测中的焦损Focal Loss for Dense Object Detection

概述

到目前为止精度最高的物体检测器是基于R-CNN推广的两阶段方法,其中分类器被应用于稀疏的候选物体位置集。相比之下,应用于可能对象位置的规则、密集采样的单级检测器具有更快和更简单的潜力,但是到目前为止已经落后于两级检测器的精度。在这篇文章中,我们调查了为什么会出现这种情况。我们发现,在密集检测器的训练过程中遇到的极端的前景-背景类不平衡是主要原因。

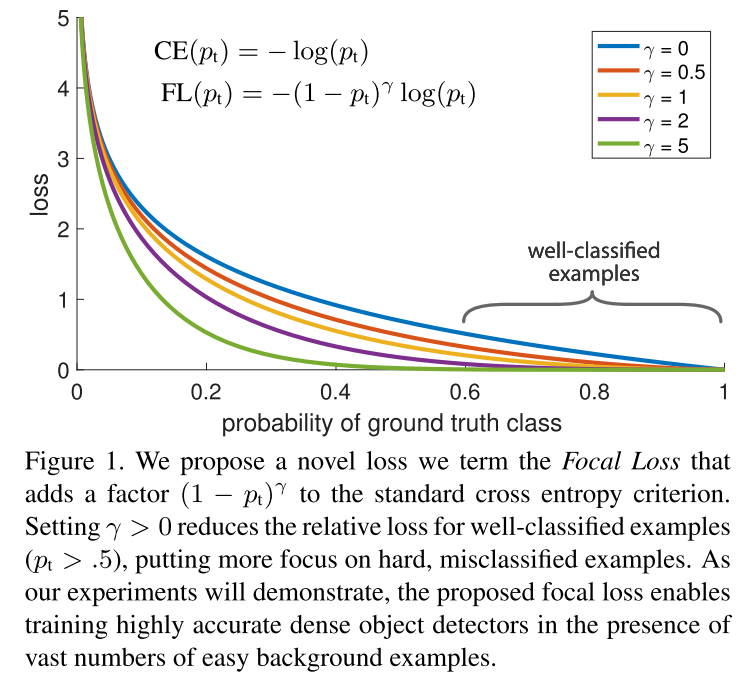

我们建议通过重塑标准的交叉熵损失来解决这一类不平衡问题,从而降低分配给分类良好的示例的损失。我们的新型失焦将训练重点放在一组稀疏的硬例子上,并防止大量容易的负片在训练期间淹没探测器。损失函数是动态缩放的交叉熵损失,其中,随着对正确类别的置信度的增加,比例因子衰减到零。直观地说,该比例因子可以在训练过程中自动降低简单示例的权重,并快速将模型集中在难示例上。

为了评估消焦的效果,我们设计并训练了一个简单的高密度探测器,我们称之为RetinanNet。我们的结果表明,当使用焦损进行训练时,RetinanNet能够与以前的单级检测器的速度相匹配,同时超过所有现有的最先进的两级检测器的精度。

交叉熵损失

对于二值分类,我们引入了从交叉熵损失开始的焦点损失。CE损失可视为图1中的蓝色(顶部)曲线。此损失的一个值得注意的属性是,即使是容易归类的示例也会导致非平凡程度的损失。当总结大量简单的例子时,这些小的损失值可能会压倒稀有类别。

解决类不平衡的一种常用方法是为不同的类引入一个权重因子??ˆˆ[0,1]。在实际操作中,可以通过倒数类频率来设置,也可以将其作为一个超参数通过交叉验证来设置。

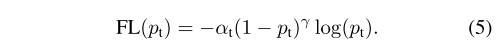

焦损

我们发现,密集检测器训练过程中遇到的大类不平衡盖过了交叉熵损失。容易分类的负片构成了损失的主要部分,并主导了梯度。虽然“?”平衡了正反两个例子的重要性,但它并不区分容易的例子和难的例子。相反,我们建议重塑损失函数,以减轻简单示例的权重,从而将训练重点放在硬性否定上。

我们将焦损定义为lhs,其中?‰元0是一个可调的聚焦参数。我们注意到焦散的两个性质。

- (1)当实例分类错误且p_t较小时,调制因子接近1,损耗不受影响。当p_t接近1时,因子变为0,分类良好的例子的损失被降低。

- (2)聚焦参数³平滑地调整简单示例的降权速率。当?³=0时,FL相当于CE,并且随着?³的增加,调制因子的影响也同样增加(我们发现?³=2在我们的实验中效果最好)。

直观地说,调制因子降低了简单示例的损耗贡献,并扩展了示例接收低损耗的范围。例如,当χ³=2时,与CE相比,分类为p_t=0.9的示例的损耗将降低100µm。这反过来又增加了纠正错误分类示例的重要性。

在实践中,我们使用的是误差±平衡形式的焦损,因为它比非误差±平衡形式的精确度略有提高。

班级失衡与模型初始化

缺省情况下,二分类模型被初始化为具有相等的输出y=?ˆ‘1或1的概率。在这样的初始化下,在存在类不平衡的情况下,由于频繁类造成的损失可能主导总损失,并且在早期训练中导致不稳定。为了应对这一点,我们引入了a?EUPERE-EUROœ的概念,用于在训练开始时由模型为稀有类(前景)估计的p的值。我们用EURO表示先验,并将其设置为使得模型-EURO™对于稀有类的示例的估计p是低的,例如0.01。我们注意到,这是模型初始化的改变,而不是损失函数的改变。我们发现,在班级严重失衡的情况下,这可以提高交叉熵和焦点损失的训练稳定性。

类不平衡与两级检测器

两级检测器通常采用标准交叉熵损失和地址类不平衡两种机制进行训练:(1)两级级联和(2)有偏小批量抽样。第一级联阶段是对象建议机制,其将几乎无限的可能对象位置集降低到一千个或两千个。重要的是,选定的方案不是随机的,但很可能与真实的物体位置相对应,这消除了绝大多数容易的负片。当训练第二阶段时,通常使用有偏抽样来构建包含例如1:3正反样本比率的小批次。此比率类似于通过采样实现的隐式±平衡因子。焦点损失被设计成通过损失函数直接在一级检测系统中解决这些机制。

RetinaNet检测器

- (A)生成丰富的多尺度卷积特征金字塔(B)。

- Retinanet将两个子网连接到该主干,一个子网用于分类锚盒(C),另一个子网用于从锚盒回归到地面真实对象盒(D)。

- 网络设计特意简单,这使得这项工作能够专注于一种新颖的焦损功能,该功能消除了我们的单级检测器和最先进的两级检测器(如带FPN的FPN更快的R-CNN)之间的精度差距,同时以更快的速度运行。

特征金字塔网络骨干网:我们采用来自的特征金字塔网络(FPN)作为RetinaNet的主干网络。简而言之,FPN增加了一个具有自上而下路径和横向连接的标准卷积网络,因此该网络可以有效地从单分辨率输入图像构建丰富的多尺度特征金字塔。金字塔的每一级都可用于检测不同尺度的对象。我们在ResNet架构之上构建FPN。我们构造一个等级为P3到P7的金字塔,其中l表示金字塔等级(P1的分辨率比输入的分辨率低2l)。所有金字塔级别都有C=256个通道。虽然许多设计选择并不重要,但我们强调使用FPN主干IS;仅使用最终ResNet层的功能进行初步实验,可获得较低的AP。

锚杆:锚杆在棱锥体层级P3到P7上的面积分别为32²到512²。在每个金字塔级别,我们使用三种纵横比{1:2,1:1,2:1}的锚点。对于比原始fpn更密集的比例覆盖,在每个级别上,我们添加大小为原始的3个纵横比锚点集的{2â�°,2^(1/3),2^(2/3)}的锚点。这改进了我们设置中的AP。总共每个级别有A=9个锚点,并且跨级别,它们覆盖了网络的™输入图像的32813个像素的比例范围。为每个锚点分配长度K的分类目标的一个热点矢量,其中K是对象类的数量,以及箱回归目标的4个矢量。使用0.5的并集交集(IOU)阈值将锚点指定给地面真实对象框;如果锚点的IOU在[0,0.4]中,则将其指定给背景。由于每个锚点至多分配给一个对象框,因此我们将其长度K标签向量中的相应条目设置为1,将所有其他条目设置为0。如果未指定锚点(在[0.4,0.5)中重叠时可能会发生这种情况),则在训练期间会忽略该锚点。长方体回归目标计算为每个锚点与其指定对象长方体之间的偏移,如果没有指定,则省略。

分类子网:分类子网为A个锚和K个对象类中的每一个预测对象在每个空间位置出现的概率。此子网是连接到每个FPN级别的小型FCN;此子网的参数在所有金字塔级别之间共享。从给定的金字塔级别获取具有C通道的输入特征地图,子网应用四个3?-3卷积层,每个3?-3卷积层都带有C过滤器,每个都紧跟着REU激活,然后是带有KA过滤器的3?-3卷积层。最后,附加S型激活以输出每个空间位置的KA二元预测。在大多数实验中,我们使用C=256和A=9。它不与盒回归子网共享参数。

盒回归子网:盒回归子网的设计与分类子网相同,不同之处在于它终止于每个空间位置的4A线性输出。对于每个空间位置的每个A锚点,这4个输出预测锚点和地面真值框之间的相对偏移。我们使用了一种与类无关的边界盒回归器,它使用的参数更少,并且我们发现它是同样有效的。对象分类子网和盒回归子网虽然共享共同的结构,但使用不同的参数。

推理和训练

推断:为了提高速度,在将检测器置信度设置为0.05的阈值之后,我们只从每个FPN级别最多1k个得分最高的预测中解码BOX预测。来自所有级别的顶级预测被合并,并且应用阈值为0.5的非最大抑制来产生最终检测。

焦点损失:我们使用本文介绍的焦点损失作为分类子网输出的损失。我们发现,³³=2在实践中工作得很好,并且Retinanet对³³?ˆˆ[0.5,5]是相对健壮的。图像的总焦损计算为所有?ˆ?100k锚的焦损总和,按分配给地面实况框的锚的数量进行归一化,而不是总的锚,因为绝大多数锚是容易负片的,在焦损下可以忽略不计的损失值。最后我们注意到,分配给稀有类的权重(?)也有一个稳定的范围,但它与³³相互作用,使得有必要将两者一起选择。一般情况下,随着³的增加,应该略微减小?(对于?³=2,??=0.25效果最好)。

初始化:除了Retinanet子网中的最后一个之外的所有新的转换层都用偏置b=0和高斯加权填充来初始化,其中下一个ƒ=0。对于分类子网的最后一个Conv层,我们将偏差初始化设置为b=?ˆ‘log((1?ˆ’SUB EURO)/SUB EURO),其中SUBE EURO指定在训练开始时,每个锚都应该被标记为前景,置信度为?ˆ?SUBDEN EURO。我们在所有实验中都使用SUBEURE=0.01,尽管结果与精确值是稳健的。该初始化防止了大量的背景锚在训练的第一次迭代中产生大的、不稳定的损失值。

原创文章,作者:fendouai,如若转载,请注明出处:https://panchuang.net/2021/07/22/%e2%80%8a-%e2%80%8a%e7%9b%ae%e6%a0%87%e6%a3%80%e6%b5%8b20%e5%b9%b4%e8%ae%ba%e6%96%87%e9%98%85%e8%af%bb%e7%bb%bc%e8%bf%b0%e4%b8%89-2/