一文上手Tensorflow2.0之tf.keras|三

本文是全系列中第9 / 23篇:TensorFlow 从入门到精通

- Tensorflow 介绍和安装

- 【干货】史上最全的Tensorflow学习资源汇总

- 文末福利|一文上手TensorFlow2.0(一)

- TensorFlow 卷积神经网络手写数字识别数据集介绍

- 特征工程

- 一文上手最新TensorFlow2.0系列(二)

- 深度学习之激活函数

- Tensorflow实现MNIST手写数字识别

- 一文上手Tensorflow2.0之tf.keras|三

- 卷积神经网络概述

- 损失函数综述

- 一文上手Tensorflow2.0(四)

- TensorFlow 一步一步实现卷积神经网络

- Tensorboard 详解(上篇)

- 深度学习发展史

- Tensorflow从入门到精通之——Tensorflow基本操作

- Tensorboard详解(下篇)

- 卷积的发展历程,原理和基于 TensorFlow 的实现

- 五大经典卷积神经网络介绍:LeNet / AlexNet / GoogLeNet / VGGNet/ ResNet

- TensorFlow 多GPU使用详解

- 一文彻底搞懂BP算法:原理推导+数据演示+项目实战(上篇)

- TensorFlow 实战卷积神经网络之 LeNet

- 深度学习之视频人脸识别系列二:人脸检测与对齐

【磐创AI导读】:本系列文章介绍了与tensorflow的相关知识,包括其介绍、安装及使用等。本篇文章将接着上篇文章继续介绍它的使用。查看上篇:一文上手最新TensorFlow2.0系列(二)。想要获取更多的机器学习、深度学习资源,欢迎大家点击上方蓝字关注我们的公众号:磐创AI。

-

Tensorflow2.0 介绍 -

Tensorflow 常见基本概念 -

从1.x 到2.0 的变化 -

Tensorflow2.0 的架构 -

Tensorflow2.0 的安装(CPU和GPU) -

Tensorflow2.0 使用 -

“tf.data” API -

“tf.keras”API

-

使用GPU加速 -

安装配置GPU环境 -

使用Tensorflow-GPU

3 TensorFlow2.0使用

3.2 “tf.keras”API

import tensorflow as tf

from tensorflow.keras import layersmodel = tf.keras.Sequential([

# 添加一个有64个神经元的全连接层,“input_shape”为该层接受的输# 入数据的维度,“activation”指定该层所用的激活函数

layers.Dense(64, activation='relu', input_shape=(32,)),

# 添加第二个网络层

layers.Dense(64, activation='relu'),

# 添加一个softmax层作为输出层,该层有十个单元

layers.Dense(10, activation='softmax'),

])model = tf.keras.Sequential()

model.add(layers.Dense(64, activation='relu', input_shape=(32,)))

model.add(layers.Dense(64, activation='relu'))

model.add(layers.Dense(10, activation='softmax'))model.compile(optimizer=tf.keras.optimizers.Adam(0.001),

loss='categorical_crossentropy',

metrics=['accuracy'])import numpy as np

data = np.random.random((1000, 32))

labels = np.random.random((1000, 10))

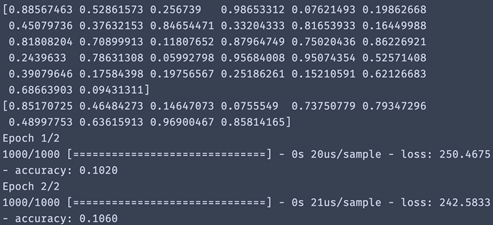

print(data[0])

print(labels[0])

model.fit(data, labels, epochs=2, batch_size=32)代码中我们随机生成了样本数据和类标。使用“model.fit”来执行模型的训练,其中参数“data”和“labels”分别为训练数据和类标,“epochs”为训练的回合数(一个回合即在全量数据集上训练一次),“batch_size”为训练过程中每一个批次数据的大小。输出结果如图1所示。

图1 输出结果

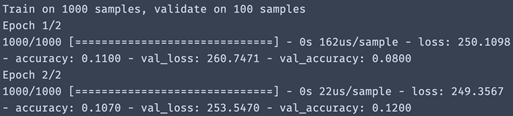

val_data = np.random.random((100, 32))

val_labels = np.random.random((100, 10))

model.fit(data, labels, epochs=2, batch_size=50,

validation_data=(val_data, val_labels))

# 创建训练集Dataset

dataset = tf.data.Dataset.from_tensor_slices((data, labels))

dataset = dataset.batch(50)

# 创建验证集Dataset

val_dataset = tf.data.Dataset.from_tensor_slices((val_data, val_labels))

val_dataset = val_dataset.batch(50)

model.fit(dataset, epochs=2, validation_data=val_dataset)# 模型评估,测试集为NumPy数据

model.evaluate(data, labels, batch_size=50)

# 模型评估,测试集为Dataset数据

model.evaluate(dataset, steps=30)

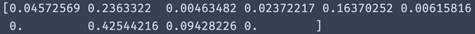

result = model.predict(data, batch_size=50)

print(result[0])

# 单独的一个输入层

inputs = tf.keras.Input(shape=(32,))

# 网络层可以像函数一样被调用,其接收和输出的均为张量

x = layers.Dense(64, activation='relu')(inputs)

x = layers.Dense(64, activation='relu')(x)

# 输出层

predictions = layers.Dense(10, activation='softmax')(x)# 创建模型

model = tf.keras.Model(inputs=inputs, outputs=predictions)

# 编译模型

model.compile(optimizer=tf.keras.optimizers.RMSprop(0.001),

loss='categorical_crossentropy',

metrics=['accuracy'])

# 训练模型

model.fit(data, labels, epochs=2, batch_size=50)class MyModel(tf.keras.Model):

def __init__(self, num_classes=10):

super(MyModel, self).__init__(name='my_model')

# 分类任务的类别数

self.num_classes = num_classes

# 定义我们自己的网络层

self.dense_1 = layers.Dense(32, activation='relu')

self.dense_2 = layers.Dense(num_classes, activation='sigmoid')

def call(self, inputs):

# 使用“__init__”方法中定义的网络层来构造网络的前馈过程

x = self.dense_1(inputs)

return self.dense_2(x)model = MyModel(num_classes=10)

# 编译模型

model.compile(optimizer=tf.keras.optimizers.RMSprop(0.001),

loss='categorical_crossentropy',

metrics=['accuracy'])

# 训练模型

model.fit(data, labels, batch_size=50, epochs=5)-

tf.keras.callbacks.ModelCheckpoint:定期保存模型。

-

tf.keras.callbacks.LearningRateScheduler:动态的改变学习率。

-

tf.keras.callbacks.EarlyStopping:当模型在验证集上的性能不再提升时终止训练。

-

tf.keras.callbacks.TensorBoard:使用TensorBoard来监测模型。

回调函数的使用方式如下:

callbacks = [

# 当验证集上的损失“val_loss”连续两个训练回合(epoch)都没有变化,则提前结束训练

tf.keras.callbacks.EarlyStopping(patience=2, monitor='val_loss'),

# 使用TensorBoard保存训练的记录,保存到“./logs”目录中

tf.keras.callbacks.TensorBoard(log_dir='./logs')

]

model.fit(data, labels, batch_size=50, epochs=5, callbacks=callbacks,

validation_data=(val_data, val_labels))# 创建一个简单的模型

model = tf.keras.Sequential([

layers.Dense(10, activation='softmax', input_shape=(32,)),

layers.Dense(10, activation='softmax')

])

model.compile(optimizer='rmsprop',

loss='categorical_crossentropy',

metrics=['accuracy'])

model.fit(data, labels, batch_size=32, epochs=5)

# 将整个模型保存为HDF5文件

model.save('my_model')

# 加载保存的模型

model = tf.keras.models.load_model('my_model')# 将模型的权重参数保存为HDF5文件

model.save_weights('my_model.h5', save_format='h5')

# 重新加载

model.load_weights('my_model.h5')

# 将模型的结构保存为JSON文件

json_string = model.to_json()

留言送书福利

/ 今日赠送书籍 /

《Python数据挖掘与机器学习实战》

/ 今日留言主题 /

原创文章,作者:fendouai,如若转载,请注明出处:https://panchuang.net/2019/08/20/8159759eab/

点击下方

点击下方